AI技術潛在威脅與解決策略 (林國誠)

人工智能(AI)無疑是一種強大的工具,能為我們創建各種內容,提升生活品質。然而,任何工具在使用不當或不謹慎的情況下都可能引發問題,乃至嚴重安全風險。筆者最近閱讀了一篇新聞,講述英國一所大學的研究團隊,透過錄取重複按下鍵盤的打字聲音,進行AI模型訓練,得到的結果令人吃驚!AI透過機器學習的方法,根據每個按鍵產生的不同聲響,成功識別出打字的內容,準確度甚至高達95%。

試想像,如果這種AI技術落入不法人士手中,隨時成為一種竊取個人資訊或密碼的強大利器,引發資料安全問題。

考慮到這種AI工具能夠持續接收用戶的輸入指令來訓練模型,筆者認為讀者在使用AI進行個人或工作相關應用時,有幾點需要留意。特別是當向AI工具輸入文字指令,要避免無意或有意地輸入包含個人資訊或公司機密的內容。

在使用AI工具之前,需要清楚自己使用AI的目的是什麼,為了內容創作、資料分析,還是執行其他任務?有了目標,就可選擇適當的指令,輸入指令時,避免透露個人或敏感訊息,包括姓名、生日、地址、電話號碼和信用卡資料等。在訓練AI模型時,也要避免使用真實的數據,尤其涉及私隱的數據。如有需要,可以使用虛構或匿名的數據例子。

對於企業來說,AI衍生的安全問題更加重要。有人曾輸入公司的商業機密,導致資料外洩,令公司帶來損失。因此,愈來愈多商業機構已制定AI工具使用指南,提示員工避免採用AI工具生成代碼來編寫程式,或者在產品發布之前,不得輸入產品相關訊息。

AI無疑已成為一種普及工具。在設計產品、優化流程時,人們會應用AI獲取參考建議。在訓練AI的過程中,你所提供資料的完整性和準確度至關重要,以便生成更精準、更符合公司需求的內容。因此,企業難以「一刀切」地完全避免使用AI。筆者有一個兩全其美的建議,就是直接把AI架設在公司內部,完全與外部互聯網隔離,既大大減低資料外洩風險,又可借助AI發揮生產力。

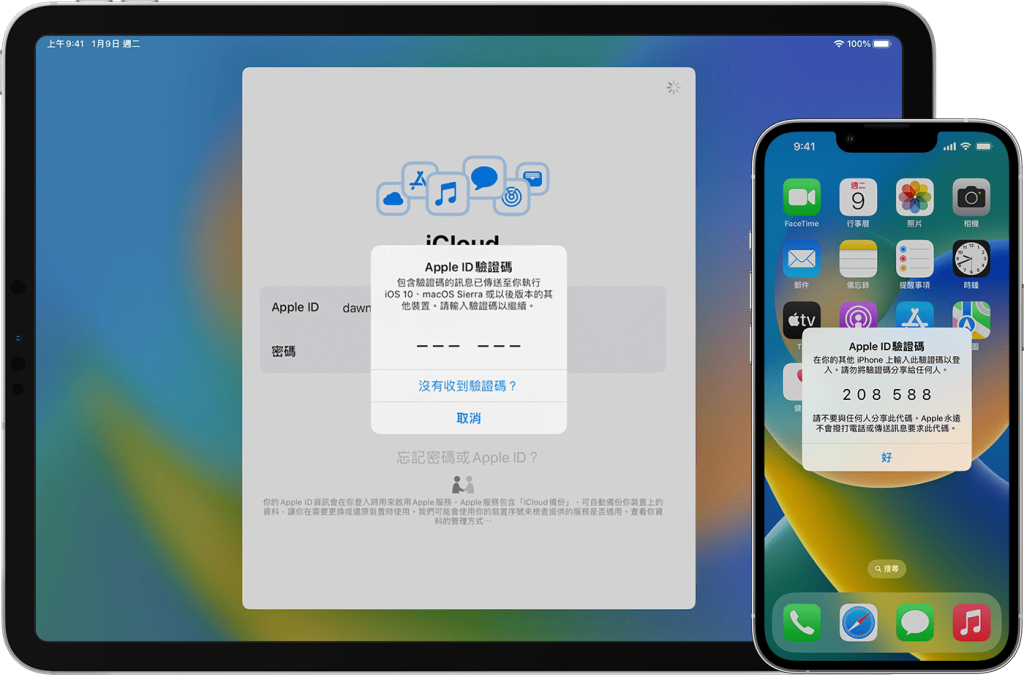

事實上,不同機構分別採用不同方法降低資料被竊風險,例如網上銀行或社交媒體網站均已支援雙重認證(Two-Factor Authentication, 2FA)功能,這種2FA功能提供了一個額外的安全層,即使AI能成功破解你的密碼,但因為認證碼是隨機生成並且有時限,使不法分子利用AI竊取資訊的難度大為提高。

更多林國誠文章:

支持EJ Tech

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。