AI叛變怎麼辦? (呂婉瑩)

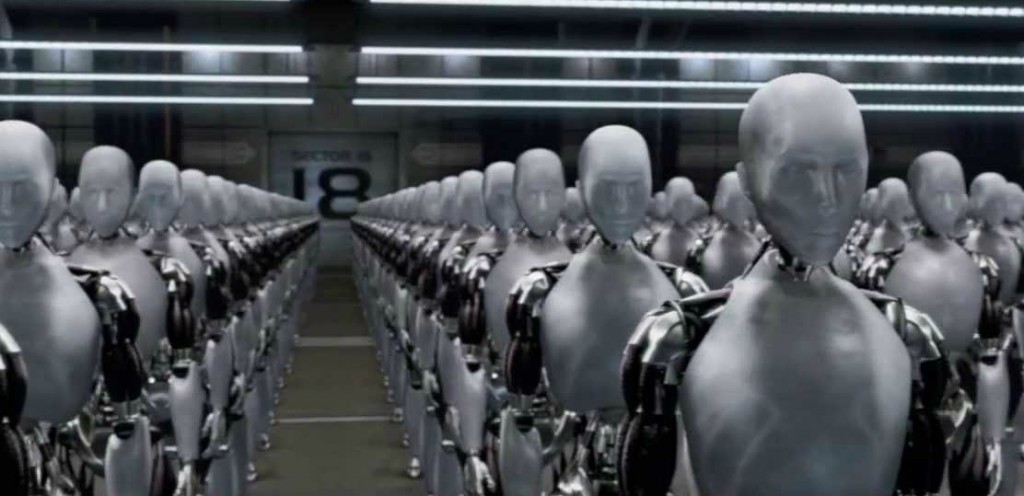

電影《智能叛變》(I, Robot)在機械人程式裏植入了3條定律。(Youtube 截圖)

當最新版人工智能(AI)電腦AlphaGo大勝世界第一棋手柯潔,很多人終於意識到AI不再是科幻片情節,比人類更聰明的AI如果有一天叛變怎麼辦?

這正是2004年電影《智能叛變》(I, Robot)的橋段,電影中機械人已是人類的好幫手,機械人生產商為防止機械人危害人類,所以在機械人程式裏植入了3條定律:

一、機械人不可以傷害人類,人類傷害機械人時不可以反抗。

二、除非有違第一條定律,否則機械人一定要遵從人類的命令。

三、除非有違第一條和第二條定律,否則機械人一定要保護自己的生命安全。

AI專家、美國柏克萊大學電子工程及計算機系教授Stuart Russell認為,現實生活比有明顯規則和套路的棋盤複雜得多,要令AI真的成為人類日常生活的夥伴,用以上3條定律會非常危險。電腦都是收到指令就會使命必達,如果你叫它將所有東西都變成金子,它真的會好像古希臘神話Midas國王獲得一個神秘陌生人應許了他點石成金的願望一樣,結果國王觸摸的任何東西,包括愛的人甚至是食物都變成金子,國王的下場是在無盡的寂寞中餓死。

當然,人類還有個絕招,就是在AI電腦不聽話時將它關機,這就正是電影《2001太空漫遊》(2001: A Space Odyssey)的情節,AI電腦HAL原來瞞着太空船的船員有秘密任務,結果男主角David以關機制止HAL。可是如果HAL是如今的AI電腦,它根本不會讓你關機。因此Russell教授認為為AI電腦制定的3條原則,應該改為︰

一、為他人着想(altruism);

二、謙遜(humility);

三、明白人類的動機。

Russell教授的實驗室有個叫PR2的AI機械人,它背後有個大大的開關掣,實驗其中一個目標就是看看PR2會不會容許人類將它關掉。PR2獲得的指令是去取一杯咖啡,如果根據傳統定律,PR2會認為它如果「死了」就不能取咖啡,所以一定不會讓人關掉它,而且可能會清除所有阻止它取咖啡的障礙。

不過如果用了新的原則,當你去將它關掉時,根據原則一和二,PR2的思考邏輯變成︰「一定是我有出錯所以人類想要關掉我,雖然我不明白錯在哪裏,但亦會容許人類將我關機。」

當PR2肯順服被關機後就要教它明白第三個原則,方法是讓它「觀察」並不只限於它主人,還有其他人的行為,明白人類行為的動機就懂得分辨是非,並不會因為它的主人是壞心腸就會跟着壞事做盡,反而會幫忙阻止。相信PR2「成材」不會是很遙遠的事,人類要加把勁了!(取材自Stuart Russell, “3 principles for creating safer AI”, May 2017, TED Talks)

更多呂婉瑩的文章:

支持EJ Tech

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。